画像処理を2足歩行ロボに生かす

画像処理を2足歩行ロボットに活かす方法として、バトルの支援システムを考えてみた。

こんな感じで、リングを上から撮影。

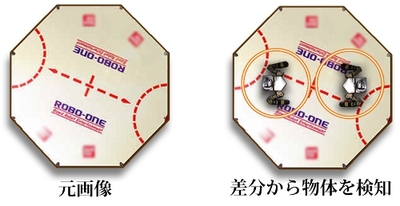

差分をとって物体を検知。今回は頑張って、画像作ってみたw

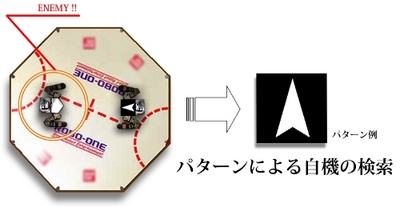

パターンマッチングでMYロボットを判別する。

応用としては、クリックした場所まで移動とか、攻撃とかいろいろ応用できると思う。

ちなみにテンプレートマッチングではなく計算でマッチングさせないと認識率的にキツイだろう。

で・・・、相変わらず机上の空論ばっかり並べて・・・って思われるのもなんなんで、思ったが吉日。

速攻作ってみた。

こんな感じ。

とりあえず、MYロボットの検知のみ。画像のなかのワールド座標と方向(角度)を算出します。

なんというか、よく落とします。

高速で移動するロボットにパターンマッチングは厳しいものがあります。

たぶん、単純な図形にして色パターンで認識させる方が白黒パターンより良さそうです。

これを、改良すれば相手のマシンを常に検知し続けるとともに、自分の方向も見失うことはないでしょう。

第11回ROBO-ONEのテーマ「人の役に立つ事」にもなにか活かせるかなぁ・・・。

ども,かつです.

OpenCV,面白そうですね.ちょうどInterfaceの11月号に記事が載ってました.

導入までは割りと簡単にできそうですが,

HMさんがやってるみたいなパターンマッチングで座標表示とかってやっぱり難しいんですかね?そもそもOpenCVのみで作れるのでしょうか?

Interfaceでも取り上げられていたんですね!

6月号以来、未チェックでしたw

Interfaceってことは、組み込み用途のOpenCVでしょうか?

とりあえず僕はパソコン上でやってます。

windows上にカメラ画像を取り込んで、表示させるまでが大変だった気がします。

パターンマッチング等は、OpenCVのサンプルが結構豊富なんで、それをガリガリいじっていった感じです。

認識さえ作れば、座標を表示させるのとかはすぐ出来ますよ。

とりあえず、OpenCVに加えて、僕はカメラの取り込みにDirectShowを使うので、PlatformSDKと、インテルのiplってライブラリを使用してます。

OpenCV単体ではやったことがないので分かりませんm(_ _)m

最終的にはロボットにカメラを搭載して、マイコン上でopenCVを使えたらいいと思うのですが・・・。